Verarbeiten KI-Systeme wie die LLMs Informationen wie die Aktienmärkte? Und wäre zur KI-Regulierung daher die Schaffung einer BaKI (Bundesaufsicht für KI) im Stil der BaFin sinnvoll?

mehr lesenLLM

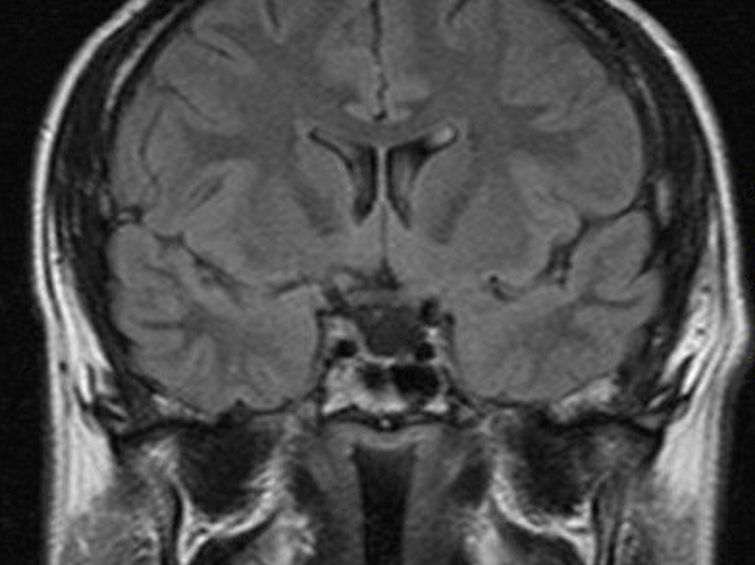

Wenn KI das Denken übernimmt und die Gehirne befreit

Künstliche Intelligenz scheint die Mühen des Denkens ebenso abzunehmen, wie wir bereits das Rechnen und die Orientierung im Raum an Geräte externalisiert haben. Die große Frage: Zu was könnten wie die freiwerdenden Kapazitäten nutzen?

mehr lesenDie Markt-Maschine: Warum LLMs nicht denken, sondern Informationen „einpreisen“

Ein LLM strebt nicht nach Wahrheit, sondern nach Informationseffizienz. Es verarbeitet das „kommunikative Echo“ der Welt nicht, um es zu „verstehen“, sondern um dessen innere Zusammenhänge – also die Kovarianzen der Begriffe – mit einer Präzision zu verwalten, die dem menschlichen Einzelverstand unzugänglich ist.

mehr lesenKönnen generative Sprachmodelle (LLM) nicht denken, weil sie nur Sprache verarbeiten?

Menschliches Denken geht auch ohne Sprache. Weil KI in Form von LLMs nur sprachliche Äußerungen lernt und in der Sprachblase bleibt, so wird behauptet, könne sie nicht denken, vor allem nichts Neues: „Entfernt man die Sprache aus einem großen Sprachmodell, dann hat man dort buchstäblich nichts mehr.“ Die KI selbst sieht das anders.

mehr lesenWelche Jobs nach einer Microsoft-Studie am ehesten von KI ersetzt werden

Besser bezahlte Jobs sind stärker durch Chatbots wie ChatGPT gefährdet, Bauarbeiter, Tellerwäscher oder Pflegekräfte stehen scheinbar auf der sicheren Seite, wenn da nicht die humanoiden Roboter wären.

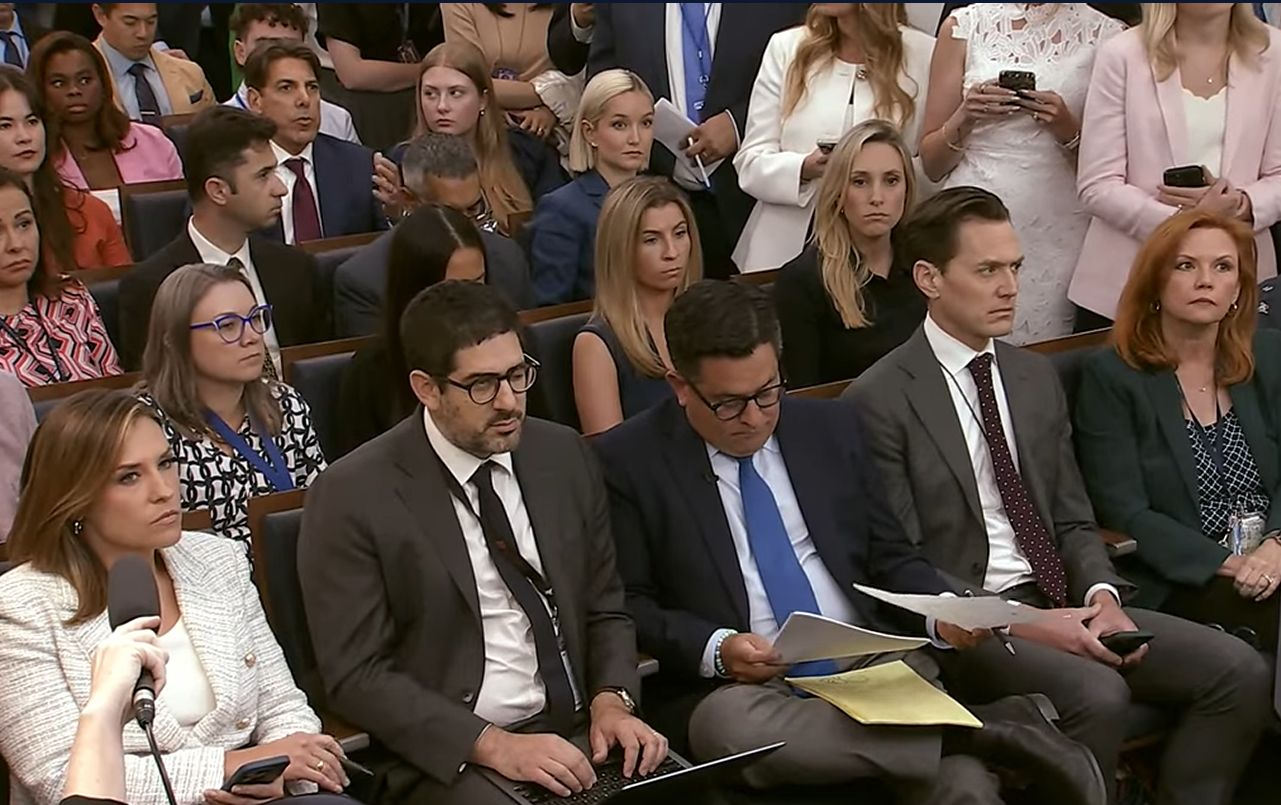

mehr lesenHaben KI-Systeme einen freien Willen und können sie Meinungsfreiheit beanspruchen?

Trump will KI-Entwicklung von jeder Regulierung freistellen. Wenn sie auch nur einen funktionalen freien Willen haben, wie ein Philosoph behauptet, wird es mit der Verantwortung schwierig. Vor einem US-Gericht ging es darum, ob Äußerungen eines KI-Systems durch Meinungsfreiheit geschützte Sprache ist.

mehr lesenSchon einfache Denkaufgaben können KI-Sprachmodelle zum Fabulieren bringen

Falsche Lösungen werden präsentiert und mit Scheinbegründungen versehen. Zudem sind die wegen ihrer Klugheit so gespriesenen Sprachmodelle gerne lernresistent.

mehr lesenWas passiert, wenn KI-Systeme wie ChatGPT in Allzweckroboter eingebaut werden?

Figure AI kooperiert mit Open AI und will mit viel Investitionskapital einen sprachfähigen humanoiden Allzweckroboter mit ChatGPT bauen, der Menschen Arbeit abnehmen und diese ersetzen kann.

mehr lesenGenerative KI-Systeme neigen in Simulationen zu Eskalation, Wettrüsten und Einsatz von Atomwaffen

Es scheint auch kein vorhersehbares Muster hinter der Eskalation zu geben, weswegen es schwierig ist, technische Gegenstrategien oder Einsatzbeschränkungen zu formulieren. Wissenschaftler raten zur Vorsicht.

mehr lesen

Letzte Kommentare