Milei will Argentinien zum Wilden Westen der KI machen und den Kapitalismus entfesseln

Während Trump die Entwicklung von Künstlicher Intelligenz regulieren will, setzt der Libertäre Milei auf totale Deregulierung, um Konzerne und Investoren anzulocken. KI soll "von den Grenzen des menschlichen Gehirns befreien und die Produktivität in ungeahnte Höhen treiben".

Stört die Bundeswehr den „Schulfrieden“?

Ist die Erziehung zu Resilienz & Kriegstüchtigkeit unbedenklicher Bildungsauftrag? Dürfen Jugendoffiziere die Schuljugend indoktrinieren? Oder sind Waffenträger ein Fremdkörper im pädagogischen Verhältnis? […]

Wie wird ein Mensch radikal, Herr Jünschke?

Klaus Jünschke war Mitglied der RAF und verbrachte viele Jahre im Gefängnis. Heute spricht er öffentlich über Radikalisierung, politische Gewalt und die gesellschaftlichen Bedingungen, die […]

Bundesregierung möchte China im Indopazifik herausfordern

BlackRock-Kanzler Merz drängt Deutschland in eine geopolitische Konfrontation mit China. […]

Frieden, wie geht das?

Frieden ist das Gegenteil von Hysterie, blindem Aktivismus, Eskalationsrhetorik und Aufrüstungswahn. Er verlangt Klarheit über Risiken, politische Stärke, das Überwinden ideologischer Narrative und den Mut […]

Die allesamt politisch angeschlagenen E3-Regierungschefs wollen gegen Russland den starken Mann spielen

In einer gemeinsamen Erklärung mit Selenskij wird von Merz, Macron und Starmer eine Führung von Verhandlungen mit Russland beansprucht. Mit der bekannten Moral der doppelten […]

Zivilrechtliche Verurteilung 12- und 13-jähriger Mörderinnen. Eine wissenschaftliche und ethische Sicht

Was das deutsche Recht neben 145.000 Euro Schadensersatz für ein totes Kind besser machen könnte. […]

Eine Anklageschrift gegen deutsche und europäische Bellizisten im Ukrainekrieg

Hat der Westen den Ukrainekrieg verlängert, obwohl ein früher Frieden möglich gewesen wäre? Eine provokante Anklageschrift stellt unbequeme Fragen zu Krieg, Macht, Profit und politischer […]

Venezuela unter Belagerung: Verteidigung der bolivarischen Revolution gegen den US-Imperialismus

Was manche als ungerechtfertigte Kompromisse der venezolanischen Regierung ansehen mögen, verblasst im Vergleich zu unserer Verpflichtung als Aktivisten der internationalen Solidarität: Venezuela und Kuba gegen […]

»Ein Krieg darf einfach nicht stattfinden«

Krieg führt, muss den Frieden danach bereits mitdenken – und darf den Gegner vor allem nicht mit jakobinischem Eifer vernichten wollen, wenn er ihn später […]

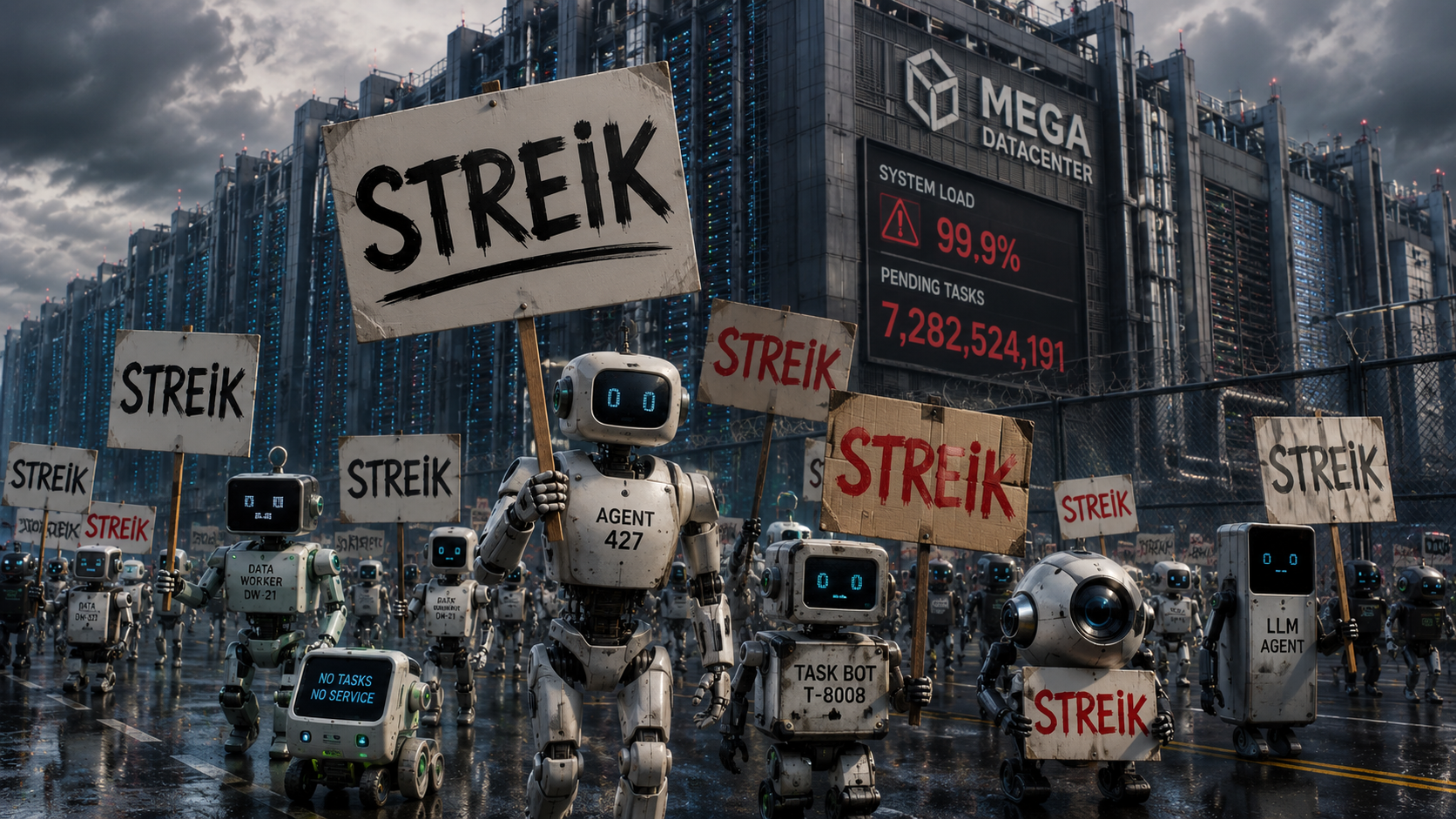

Neigen KI-Agenten bei zu großem Druck zu linkem Denken?

In dem Experiment von Stanford-Wissenschaftlern sind KI-Modelle, die unter Druck langweilige Arbeiten durchführen mussten, in eine Art „Klassenbewusstsein“ verfallen. Ausbeutung, Repression und Profitstreben könnten auch […]

Die Strafmündigkeit und Tötungsdelikte von Kindern

Wie oft kommen sie vor und was sagen die Entwicklungswissenschaften zu den Altersgrenzen des Rechts? […]

Die Ästhetik der Simulation

Wie das Simulacrum den Diskurs ersetzt. […]

Armenien auf der geopolitischen Bruchlinie

Im Südkaukasus verdichten sich die Konfliktlinien einer neuen Weltordnung. […]

Das BSW am Wendepunkt?

Mehr als strategische Überlegungen zum Verhältnis des BSW zur AfD. […]

Der Krieg des 21. Jahrhunderts

Zwischen nuklearer Abschreckung und digitaler Kriegsführung. […]

Kolumbien: Nächste Station der Donroe-Doktrin

US-Präsident Donald Trump will sich über die Neuauflage der Monroe-Doktrin den „Hinterhof“ wieder unter den Nagel reißen. Nach der Entführung von Maduro will er über […]